Ici c'est Fribourg

On April 30th, Fribourg Gottéron became champion of the Swiss ice hockey National League for the first time. I’ve watched the 2 last games of the series, boy it’s been so close. The scenario of the finale could not have been more intense.

I thought I would give a go to “a single div” exercise with the team’s logo as goal.

This is made with CSS only and using one single div. It’s no perfect match to the original but that was not the intent either. I’ve had fun playing around with this and learned a couple of things along the way.

The idea behind single div drawings has been introduced by Lynn Fisher on Mozilla Hacks. That pushes one to explore CSS as a medium, setting constraints to better master the craft. And I’m a fan of that message.

That article on Mozilla Hacks was written 12 (!) years ago but as it’s CSS, it

still works just fine. Out of the techniques Lynn presents, I’ve used

gradients, the 2 pseudo elements but no box-shadows. Besides that, I think it

was interesting to use clip-path and conic-gradient which were not

mainstream at the time of the article.

clip-path might be seen as cheating, I’m not sure. But again, the idea is to

sharpen your skills on such a project. The central F of the logo has been laid

out using clip-path. The blue shade of the central part of the letter is

actually coming from layers bellow. The F stroke is cut out of a white

rectangle part of one of the 2 pseudo elements. And I must say I still haven’t

fully wrapped my mind on how that exactly works. Look to this

codepen to see my

struggle.

conic-gradient can be used to create triangles. The technique is the same as

with the other gradients Lynn talks about. The trick is to use hard color stops

and transparent as color value to make any triangle you wish for.

By now, Lynn stopped her A Single Div CSS drawing project, but it’s a wealth of nuggets. Lot’s of stuff to learn there!

Of course, no tooling makes anybody an artist, and I could see how mind bending that quickly becomes to draw with CSS. An interesting exercise for sure and that blows my mind to see Lynn’s creations. What you can do with just a single div! Indeed that pushes one’s creativity.

Hello, World

Last time I posted a photo of our planet was when Bill Anders passed. It was a retweet. Sixty years have passed between the two shots. Each one makes me pause and appreciate how tiny we are.

A wind that blows past and does not return.

That’s simply what we are,

however angry and noisy some might be, at the end of the day, they’ll get

old, blow past and not return.

Man has dominated man to his harm.

Man has the capacity to invent the

extraordinary. Like the machinery to go to space, to take in picture this blue

marble we call home. In his gasping haughtiness though, he erects imaginary borders,

pretends he has rights over neighboors or previous earth citizens. He establishes

booklets he’s called passports that suppose some would have an easier life than

others.

Watching the misery of the world’s affairs might depress many. Marveling at such beauty captured on this photograph reminds me of the beauty of life. I’m convinced that Man has no capacity to fix what troubles us. I’m however neither nihilist nor hopeless. To the contrary, I rejoice at the inner peace that resides deep within me. For a good part, because I believe that I’ll get to experience that blue marble for ever.

Note: the developer in me wonders at seeing one webpage weighing

16.7MB. On the other hand,

it’s cool to see that NASA provides an image resizer endpoint, I fetched the

image used here with

https://www.nasa.gov/wp-content/uploads/2026/04/art002e000192.jpg?w=695. You

can give any value to the w parameter to get the image version you want.

Style it, ship it

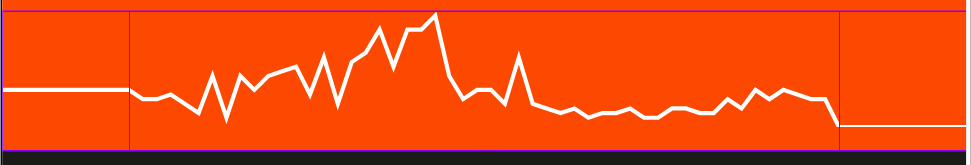

As getting the data from Strava and transforming it is now solved, what’s left is styling the spakline and making it part of an automated publishing process.

By using sal and jq as explained in the last 2 articles, I get a list of

points. I can simply visualize the those points, as a sparkline, like so:

<svg>

<polyline transform="translate(0,30), scale(1, -1)"

points="0,5 3,8 6,6 9,6 12,7 15,5 18,3 21,11 24,2 27,11 30,8 33,11 36,12 39,13 42,7 45,15 48,5 51,14 54,16 57,21 60,13 63,21 66,21 69,24 72,11 75,6 78,8 81,8 84,5 87,15 90,5 93,4 96,3 99,4 102,2 105,3 108,3 111,4 114,2 117,2 120,4 123,4 126,3 129,3 132,6 135,4 138,8 141,6 144,8 147,7 150,6 153,6"

fill="transparent"

stroke="#aaa">

</polyline>

</svg>

I simplified a tiny bit but the important part is those points. These are

what the jq transformation outputs.

And this renders like this:

As cool as it is, there’s still some work!

CSS Layout and Styles

I wanted to have the sparkline in the footer of my running blog, taking more space than that, actually the full viewport’s width.

So I started to brainstorm on Codepen. I obviously took inspiration in what GitHub did on its repositories page. Making the sparkline itself bigger, with some text around is nothing difficult. I just had to find the colors and dimensions I wanted. For the colors, I ended up with something close to what Strava uses.

To make it span the entire width of the viewport, I then used

flex

ability to stretch an element. By duplicating the first and last points of the

sparkline and then put them in their own svg element, it’s been easy to

stretch those 2 points at the beginning and at the end of the sparkline to give

a sense of continuity.

Automate the whole process

runboyrun.ch used to run on an EC2 instance of Ghost. In the meantime, I slightly adapted the setup. I’m still using ghost but only locally to manage all my posts. By locally, I mean on my home network, it actually runs on a lightweight Lenovo laptop which runs as my cost friendly homelab.

The version publicly available is hosted on AWS S3 with Cloudfront as CDN. Again, more cost friendly, but makes more sense overall too.

That being said, I have my custom machinery to push new versions of that blog to S3. Nothing fancy, a bash script that’s polling the latest version of the blog from the local ghost instance and using the AWS cli to interact with S3 and Cloudfront to publish the new content and invalidate the CDN caches. Now on top of that, I integrated all the elements I just explained.

Every morning, a cron job executes that script which uses sal to fetch the

latest Strava activities. On my homelab server, sal uses a valid state.json

file to make the execution non interactive. Check out the previous

article if needed, I described how this file is used and where

it’s stored.

Then jq to transform the Strava activities into a series of points that are

then added to the blog content via a m4

include macro.

I quite like this solution and honestly I love checking out runboyrun.ch the next day of a run. That’s just one more thing that keeps me motivated to keep that line moving and that yearly distance above 1000 kilometers.

It’s been a fun side project.

From my Strava activites into one sparkline

With sal it’s now possible to fetch on demand all my personal Strava

activities from the past year. The next step is to transform this raw dataset into

a sparkline. But before diving into this, let’s see concretly how to install

and start using sal.

Setup walkthrough

sal’s README explains it all, let’s go

through this step by step.

-

On Strava, create an API Application.

-

Fetch

salfrom the GitHub repository’s release section or build it on your machine. -

Launch

sal. You’ll need a browser to complete the first launch as it has to fetch an authentication token and ask for your approval in doing so.You’ll need the

client_idand theclient_secretthat got generated on step 1 as well. They are available anytime on the settings page of your Strava profile.SAL_CLIENT_ID=<your_client_id> SAL_CLIENT_SECRET_ID=<your_client_secret_id> sal -

Under the default root directory for user-specific configuration, you’ll find the authentication details that

salwill use on further launches. Those are stored undersal/state.json. That will come handy later.

If everything is alright, that should be it, the past year of Strava activities are dumped in your terminal!

Raw data into a sparkline

That dataset is an array of activities. To transform that into a sparkline, that needs to go through a few steps of transformations.

The idea is to get the total distance per week and then to plot those 52 points on a line. Besides that, one or two other stats are computed so that we can generate the accompanying text.

The whole pipeline uses jq and m4. The bulk of the process is the following:

|

|

A whole bunch of things are taking place 🤠:

mapandselectfilters the dataset to retain only running and trailrunning activities- another

maptransforms each entries to pick only the distance and the date of the activity; the%g%Vdate format creates a key we’ll use to group activities of the same week. For example for today2608is%g%V group_byprepares the dataset so that we can make a total per week, it produces an array of activites per week, or more precisely per%g%V- the next

mapsums all the activites of each week - to ensure there’s no hole in the series, another array is created. It contains the 52 past weeks and an initial distance to zero

- next, it groups the 2 arrays in one, with the week as key

- for each week, it sums the

.distancekey, from each array; if I don’t run on a given week, this would ensure that I still have a datapoint for that week. At that stage, the dataset is made up of week keys and _distance values, as in[{"2607": 42}, ...]. - lines 10-11 normalize the

.distancevalues - lines 13-14 are the final touches to generate the 52 datapoints that we are

going to draw with svg. The

. * 3is for the width of a given week. So the whole sparkline would be approximately 160px wide. There was definitely a bit of playing around before I’d end up with a pleasing rendering activities.jsoncontains the output ofsal, the past 52 weeks of Strava activities

So SL_DATAPOINTS contains the datapoints, something like 0,6 3,3 6,5...,

and are included in a m4 template that I prepared.

More on this next step, in yet another upcoming and final post about this fun little side project.

Visualizing my year of running with one sparkline

Around 2010, I started running. Regularly. I was going through a very tough time – betrayal, abuse and loss of trust. That was my darkest period. It took me years to recover some self-esteem and my usual cheerfulness. Although I’ve never lost hope, I often felt powerless and stuck.

Running became an outlet that helped me greatly rebuild myself, to this day it helps me to balance my emotions, to process my life and expand my gratitude.

Thanks to running, I know that I may show a good dose of grit. I know that I can be disciplined enough to follow a training program to be fit to run a marathon at a given pace.

Thanks to running I’ve had unforgettable experiences. I’ve seen places, I’ve strengthened friendships. I’ve marveled at what our body is capable of achieving.

I’ll always be thankful that running is there.

Early came technology to the mix, I’ve used initially Runkeeper as a platform to track my runs. I think I purchased my first training programs there too. It started with half-marathon goals. Later came Strava, that’s where I post my runs until this date.

I used to have a subscription on Strava and that meant having access to a whole bunch of different tracking data. I would from time to time check my yearly progress in elevation, distance, etc.

But I dropped that subscription a couple of years ago as my running volume decreased drastically. New (happy) life priorities.

With no subscription comes less statistics, that’s part of the deal. But Strava provides an API you can use to fetch all your personal activities.

I’m using this API to generate a sparkline on my running blog. That one gives me the one statistic that I still like to look at: yearly distance.

To generate and publish it automatically I’m using sal a command-line tool I’ve created to first fetch the data needed.

I chose Go to build sal because I’ve been reading a couple of Go codebases over the past 2 years1, found nice what I read and thought this command line utility would be a perfect side project to get some practice. I liked especially how easy it’s been to generate cross-platform binaries. Knowing that I’m developing on a MacBook and that my goal was to run this little thing on my tiny home server running a Linux distro, that cross-compiling feature has been a decisive factor!

Every day, sal downloads all my Strava activities from the past year, 52 weeks and stores them in a JSON file. I get all the details I need in there, specifically distance, the type of the activity and its datetime.

That’s the foundation.

Then how do you transform this raw dataset into a sparkline? I’ll describe that second part in another post.

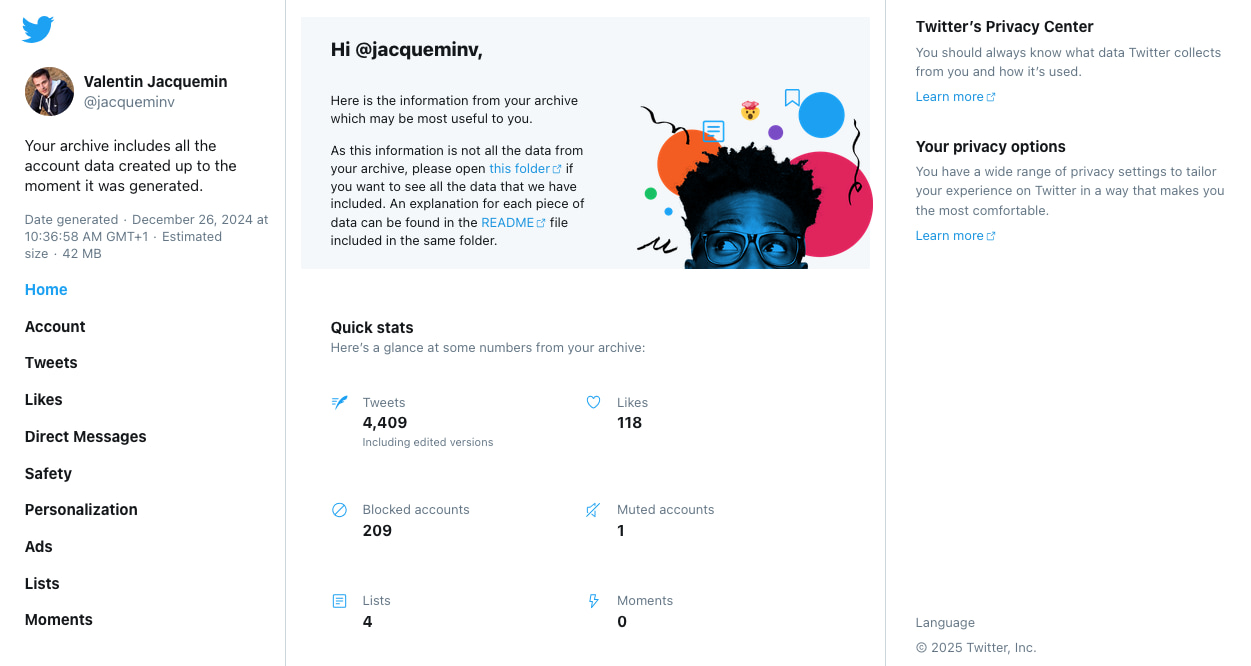

I migrated all my tweets, here's how

On how I reclaimed my tweets and imported them into my personal website

About a year ago, I closed my twitter account. Before pulling the trigger though, I’ve exported my personal content as I knew that I did not want to loose all that history of my online presence.

Funnily, that export feature still matches the Twitter branding, the guys from X did not bother taking care of that.

I got in my mailbox a fully functioning static website. Where I could browse my own feed as if Twitter still existed. You can search, filter and sort the feed as you please, all locally. The web as I like it.

I did not know what I would do with that archive a year ago. I just wanted to close my account without loosing my content. As I decided to resume my personal website, I knew that my tweets would get a new home in there.

Here’s how I migrated that content.

When you browse the archive you quickly find where to go. And as it’s a static website anyway, you can figure out how the whole thing works by looking to the sources.

twitter-archive> tree -P '*.html' -L2

.

├── assets

│ ├── fonts

│ ├── images

│ └── js

├── data

│ ├── community_tweet_media

│ ├── deleted_tweets_media

│ ├── direct_messages_group_media

│ ├── direct_messages_media

│ ├── moments_media

│ ├── moments_tweets_media

│ ├── profile_media

│ ├── tweets_media

│ └── tweets.js

└── Your archive.html

The entire collection of tweets is in app/tweets.js. From there to my own

website, it’s a matter of using a few tools to filter and re-shape that array

of microblog entries.

First, I simply kept the json compatible part of app/tweets.js, i.e. I

dropped the javascript variable declaration. I saved that into preprocess1.json.

Second, I decided to filter out any replies as I just wanted to keep my own posts. That would be too much of work to bring replies into their context, not even sure that it would be feasible at all.

jq '[.[] | .tweet.id as $id

| ( .tweet.entities.media | length > 0 ) as $hasMedia

| select(IN(paths; ["tweet", "in_reply_to_user_id"])==false)

| del(

.tweet.extended_entities,

.tweet.favorite_count,

.tweet.id_str,

.tweet.truncated,

.tweet.retweet_count,

.tweet.id,

.tweet.possibly_sensitive,

.tweet.favorited,

.tweet.entities.user_mentions,

.tweet.entities.symbols,

.tweet.entities.hashtags,

.tweet.retweeted,

.tweet.edit_info,

.tweet.source,

.tweet.display_text_range)

| .tweet.entities.media

|= if $hasMedia then $id end]' preprocess.1.json > preprocess.2.json

That filtered out about a third of my tweets.

Then I re-shaped the tweets. For example, the json payload gives the expanded URLs of any shortened link present in a tweet:

{

"tweet" : {

"entities" : {

"urls" : [

{

"url" : "https://t.co/FhmBWq39rL",

"expanded_url" : "https://activitypub.rocks/",

"indices" : [

"178",

"201"

]

}

]

},

"created_at" : "Fri Nov 01 11:54:07 +0000 2024",

"full_text" : "\"Don't you miss the days when the web really was the world's greatest decentralized network? Before everything got locked down into a handful of walled gardens? So do we.\" – https://t.co/FhmBWq39rL",

"lang" : "en"

}

},

I definitely don’t want to use the twitter URL shortener anymore. Thanks to that thorough payload, it was easy for me to translate them.

A multipass of the following jq script would convert all the shortened URLs into their expanded version.

cat preprocess.2.json | jq '[.[]

| .tweet.entities.urls[0]?.url as $url

| .tweet.entities.urls[0]?.expanded_url as $expanded_url

| (if $url then .tweet.full_text

| sub($url; "<a href=" + $expanded_url + ">" + $expanded_url + "</a>")

else .tweet.full_text end) as $text

| { tweet: {

full_text: $text,

lang: .tweet.lang,

created_at: .tweet.created_at,

entities: {

urls: .tweet.entities.urls[1:],

media: .tweet.entities.media

}

}}]' > preprocess.3.json

Once the content reshaped, I created one file per tweet under the notes section of my hugo website. I’ve used a bash script for that:

#!/usr/bin/env sh

file='preprocess.5.json'

length=$(cat "$file" | jq '. | length')

i_tweet=1

for (( i=0; i<length; i++ ))

do

created_at=$( jq -r ".[$i] | .date | todate" "$file")

output_folder="output/tweets/$(( i_tweet++ ))"

out="$output_folder/index.md"

hasMedia=$( jq ".[$i] | if .tweet.media then true else false end" "$file" )

lang=$( jq -r ".[$i] | .tweet.lang" "$file")

content=$( jq -r ".[$i] | .tweet.full_text" "$file")

template='tweet.pre'

if $hasMedia = "true" ; then

template='tweet-with-media.pre'

filename=$( jq -r ".[$i] | .tweet.media" $file)

media=$(basename $(ls tweets_media/"$filename"*))

if [[ "$media" == *.mp4 ]]; then

mediaHtml="<video autoplay loop src='/notes/$media' class='u-video'></video>"

else

mediaHtml="<img src='/notes/$media' class='u-photo' />"

fi

fi

data=$( m4 -D__CREATED_AT__="${created_at}" \

-D__LANG__="$lang" \

-D__CONTENT__="$content" \

-D__MEDIA__="$mediaHtml" \

$template)

mkdir -p "$output_folder"

echo "$data" > $out

done

That uses m4 too, simply to keep the templating outside, just a bit easier to

manage.

Here’s for example how I prepared tweet.pre. The bash script would either use

this one or tweet-with-media.pre depending on the presence or not of a media

in the tweet.

changequote(<!, !>)

---

date: __CREATED_AT__

lang: __LANG__

params:

kind: tweet

---

<p>__CONTENT__</p>

<p class="meta original-link">

First published on <a href="https://twitter.com">twitter</a>

(<a href="/articles/1/">?</a>)

</p>

That’s it! 3143 tweets kept intact, now persisted on my own website.

I migrated all my instagram photos, here's how

On how I reclaimed my instagram posts and imported them to my personal website

Instagram provides an export feature, not easy to find but the help section provided me with the right sequence of clicks. I did that in September this year. You can choose between json and html exports, I chose json and received shortly after a zip file in my mailbox. Once deflated that amounts to 85 megabytes.

➜ instagram-jacqueminv-2025-09-04-83XcnSA4-json tree -d -L2

.

├── ads_information

├── apps_and_websites_off_of_instagram

├── connections

├── media

│ └── posts

├── personal_information

├── preferences

├── security_and_login_information

└── your_instagram_activity

└── media

./media/posts and ./your_instagram_activity/media.There was no description of the archive’s content so I browse and quickly found that all my posts were under your_instagram_activity/media/posts_1.json. I decided to ignore everything else. That means my stories, comments or likes are not migrated. What I want is all the photos and their metadata so that I can keep them on my website.

That json file contains a list of entries and each has one to many media linked to it. It’s straightforward to find the link to the media file, each one is referenced via a uri property. That’s the link to the file within the very same archive, under /media/posts.

Having sorted out the structure and what I wanted, I could start playing around on the command line. For that kind of task, jq is a good candidate.

Here’s how I proceeded to only keep the attributes I needed and prepare the payload for the next step:

jq -c '[ .[] | {title: .media[0].title, date: first(.media[].creation_timestamp), pictures: .media | del(.[].creation_timestamp, .[].title, .[].media_metadata, .[].cross_post_source), location: first(.media[].media_metadata?.photo_metadata?.exif_data[0]?)} ]' posts_1.json > preprocess.json

One unpleasant surprise was that special characters were badly encoded. As I sometimes wrote my descriptions in french, that ended in the json like “matinée” for “matinée”. I did not see customization options on the export page so what I did was going through all my entries and fix them manually. Annoying. But my export is made of less than 400 entries and not that many in french so in the end, not a huge deal either. Still surprising for a service coming from a mammoth like Meta! I did that on that preprocess.json as I had not noticed that at first.

Equipped now with that filtered json I simply needed to generate the html hugo files for each entry. To achieve that part I’ve used a bash script and m4 .

#!/usr/bin/env sh

file='preprocess.json'

length=$(cat "$file" | jq '. | length')

i_insta=1

for (( i=0; i<length; i++ ))

do

created_at=$( jq -r ".[$i] | .date | todate" "$file")

output_folder="output/photos/$(( i_insta++ ))"

out="$output_folder/index.md"

content=$( jq -r ".[$i] | .title | sub(\"\n\"; \"<br/>\")" "$file" )

latitude=$( jq -r ".[$i] | .location?.latitude" "$file" )

longitude=$( jq -r ".[$i] | .location?.longitude" "$file" )

location=""

if [ "$latitude" != "null" -a "$longitude" != "null" ]; then

location="<p class='h-geo meta'><a href='https://www.openstreetmap.org/#map=15/$latitude/$longitude'>"

location+="<data class='p-longitude' value='$longitude'>$longitude</data>, "

location+="<data class='p-latitude' value='$latitude'>$latitude</data></a></p>"

fi

mediaHtml='<ul>'

lengthMedia=$( jq -r ".[$i] | .pictures | length" "$file")

for (( m=0; m<lengthMedia; m++ ))

do

media=$(jq -r ".[$i].pictures[$m].uri" "$file")

mediaHtml+="<li><figure><a href='/photos/$media'>"

if [[ "$media" == *.mp4 ]]; then

mediaHtml+="<video autoplay loop src='/photos/$media' class='u-video'></video>"

else

mediaHtml+="<img src='/photos/$media' class='u-photo' />"

fi

mediaHtml+="</a></figure></li>"

done

mediaHtml+='</ul>'

data=$( m4 -D__CREATED_AT__="${created_at}" \

-D__CONTENT__="$content" \

-D__MEDIA__="$mediaHtml" \

-D__LOCATION__="$location" \

insta.pre)

mkdir -p "$output_folder"

echo "$data" > $out

done

With the accompanying insta.pre given to m4:

---

date: __CREATED_AT__

params:

kind: insta

---

__MEDIA__

<p>__CONTENT__</p>

__LOCATION__

<p class="meta original-link">First published on <a href="https://www.instagram.com/jacqueminv/">instagram</a> (<a href="/articles/1/">?</a>)</p>

After execution, my 359 insta posts found a new home. I just had to copy the posts folder that actually contains the photos and one video.

Hiatus terminus

On why I stopped updating my personal website and social media took over. Interested to know how to reclaim your own twitter and instagram content? That’s for a future article.

I closed my twitter account about a year ago. We have to agree that social media in general got ever more toxic over the years. The promises of connection failed short. Instead, that’s a feeling of exhaustion and sadness that predominate if I spend time there.

I was using twitter mainly to stay up to date around information technology at large. I started to use twitter in October 2007. I’m not and I’ve never been an hardcore user, that was a tool to an end. Still, over the years I amassed some content that I was for some reasons attached to. Same for instagram, I posted quite a few photos there but using the platform today, with its mix of ads and unsolicited content? Not for me.

The closure of my twitter account acted as a trigger.

I used to have my own website back then but over time, when my personal life took tough turns, I took a bit of distance from all this. Actually, I lost the motivation to stay connected, to code, to write (online), to explore programming languages, technologies. Instead I did more and more running, spent time with other (new) friends and kept up with other healthy routines. Programming has been purely to get a paycheck, which is sort of sad considering how I did enjoy it before. Moving on takes time and for me it meant putting programming as a hobby on the side.

Fast-forward to years later, I moved to another place, continued to “rebuild” myself. The pinacle of that phase is when we decided to envision a life together, my now wife and I. Around that time I was even more disconnected, I was off, in heaven. That kept rebuilding me, for good and I could see that slowly my willingness to grow again in my programming, in setting a plan to give an answer to my thirst of knowledge made sense again. I started to regularly set time for my learning journey, not a huge amount as I have dear responsibilities I always strive to keep my best attention to. But learning was again in my routine, especially early mornings.

That led me to dig deeper into different areas over last years: kubernetes, css (boy how that part evolved), SRE topics, Terraform, and on and on. Learning, spending time to grow is again appealing and satisfying.

Writing always got its spot in my life. I’m excited to reclaim my own online space to keep track of my learnings and other wanderings. Social media may be tiring that’s a lesson. Producing my own content though is loaded with benefits: I know I can experiment if I have my own website, I know I can focus more on my own journey rather than looking what’s going on elsewhere passively. I mean that as a balance, staying up to date is still a goal and social media might be one way to do that. Reducing my time in staying connected to get more into producing, tracking my learnings is one clear goal of putting an end to my hiatus.

I’ll report about those learnings and lessons reaped along my way.

To start, I had in mind to reclaim my own content. Mainly the one spread on twitter and instagram. At least to start with. It’s now in good shape, there’s still a few fixes to apply but it got good enough for me to hit publish. All my tweets are in the notes section and all my insta snaps are in the photos section. The migration itself has been rewarding in terms of learnings, I’ll share about that next.

To me, I wish Happy Learning, Happy Hacking and long live to my own digital space.

Les particularités de Javascript

Ça m’a fait plaisir de lire l’article Ten Oddities And Secrets About Javascript parce que je cherche un peu de motivation actuellement pour écrire sur ce blog et j’ai ici un prétexte pour ajouter une onzième particularité de Javascript fort troublante lorsqu’on ne la connait pas. Elle s’appelle hoisting feature, on pourrait traduire ça par fonctionalité de de levage…

Voici un morceau de code pour nous aider:

var score = 42;

function computeScore () {

if ( score ) {

alert(score);

}

var score = 0;

return score + 42;

}

computeScore();

Selon vous l’alert va apparaître? Si oui quelle valeur sera affichée?

Eh bien non, l’alert ne s’affichera pas. Si ça vous paraît surprenant je le comprends, mais cela signifie aussi que cet article pourrait vous apprendre quelque chose…

La portée des variables en Javascript

En Javascript il faut savoir qu’il n’y a que les fonctions qui

définissent un nouveau bloc de portée pour les variables, déclarer une

variable dans une boucle ou un if ne restreindra pas sa portée à ce

simple bloc mais bien à la fonction l’englobant ou la portée globale

dans le cas où cette dernière n’existe pas.

Sachant cela, vous comprendrez alors pourquoi ici l’alert va bien nous

afficher true:

function test () {

if ( true ) {

var isDefined = true;

}

alert( isDefined );

}

Deuxième point important concernant la hoisting feature, c’est que toute variable est déclarée en début de portée et ce même dans le cas où le développeur décide de ne pas le faire en début de portée. Si l’on reprend par exemple le code d’introduction, voici comment le comment il est interprété:

var score = 42;

function computeScore () {

var score; //"cache" (shadow) la variable globale du même nom sans l'initialiser, sa valeur est donc `undefined`

if ( score ) {

alert(score);

}

score = 0;

return score + 42;

}

computeScore();

Bonne pratique de déclaration de variable

Afin de s’éviter toutes surprises la bonne pratique recommandée est de

déclarer toutes ses variables en début de bloc et en utilisant le

mot-clé var. Omettre le var enverrait directement la variable

dans la portée globale ce qui n’est pas ce qui est recherché en général.

Le jour des triffides

Si Will Smith et son cleps seuls contre des zombies dans “Je suis une legende” ou encore Tom Cruise face aux Tripods de “La guerre des mondes” vous ont plu, en voilà un autre du genre: le jour des Triffides.

Ce livre a d’ailleurs lui aussi son adaptation cinématographique; qui date un peu par contre.

En ce qui concerne le bouquin, on se retrouve de facon similaire dans la peau d’un gars qui par (mal)chance doit affronter un monde empli de bestioles qu’il connait ma fois assez bien pour les avoir étudiées en labo: les Triffides.

Ces Triffides ce sont des arbres. Pas forcément les gentils Ents que vous connaissez. Les Triffides ne voient ni ne parlent eux, et sont exploités par les humains pour leur sève aux propriétés énergétiques très profitables.

Mais voilà, un accident et hop leur cécité n’est plus un si terrible désavantage puisqu’en face les humains ne voient plus rien non plus! La menace est sérieuse. Les Triffides sont nombreux et, bien qu’aveugles, semblent communiquer entre eux. Leur but parait loin d’être pacifique… Envie de vengence? Peut-etre. Assez pour se debarasser de leurs récents exploiteurs? A découvrir.

Je me suis laissé embarquer par ce bouquin meme si c’est le genre de scenario que l’ont retrouve dans plusieurs bouquins de science fiction. Je n’ai pas lu Je suis une légende mais Le jour des Triffides vaut largement La guerre des mondes.

Mon père m’avait un jour raconté qu’avant la guerre contre Hitler, il avait pris l’habitude de faire le tour de Londres, les yeux grands ouverts plus que jamais, pour admirer des bâtiments qu’il n’avait jamais remarqués auparavant et leur dire adieu. J’éprouvais en cet instant un sentiment similaire, mais notre situation avait quelque chose de plus tragique. La plupart des gens pouvaient avoir un certain espoir de survivre à la guerre. Là, nous avions affaire à un ennemi qui ne les laisserait pas survire.

[…]

L’esprit humain est incapable de demeurer trop longtemps dans une humeur tragique – tel un phénix, il renaît de ses cendres. Cela peut s’avérer utile ou nuisible – c’est juste une manifestation de notre volonté de vivre.